Santiago, 18 de enero de 2024 – La ciberseguridad una prioridad en la era de la IA, fue el título de la exposición realizada el día de ayer de Miguel Ángel Cañada, especialista en ciberseguridad y Vicepresidente del The European Cyber Security Organisation.

La Charla comenzó haciendo referencia a cierto personaje del libro infantil de 1871 de Luis Carroll, “que me viene muy bien para explicar lo que nosotros entendemos, lo que nosotros vemos, no solamente de la ciberseguridad, sino del impacto que la inteligencia artificial está teniendo en este ámbito. Hay un personaje de este libro, la Reina Roja, que insiste a todos los ciudadanos de su reino en decirles que para quedarse donde están tienen que correr más rápido”.

Y eso es un poco lo que ocurre con la tecnología, lo que nos pasa con la ciberseguridad, lo que nos está pasando con la inteligencia artificial, que “tenemos que ir muy rápido y nunca vamos a estar por delante”, destacó el especialista, agregando que, “en el ámbito de la ciberseguridad esto es especialmente importante, porque la ciberseguridad es una capa de tecnología que permite el desarrollo de la transformación digital y todo lo que eso implica desde el punto de vista del desarrollo económico y desde la consolidación de las sociedades, incluso de las democracias, como estamos viendo ahora”.

Frecuencia y costos de ciberataques

En el mundo cada 11 segundos hay un ataque de ransomware, un intento de secuestrar sistemas, que van desde el ordenador de una pequeña empresa hasta infraestructuras críticas de un país y en muchos casos han conseguido bloquear ese país, han conseguido bloquear el sistema de distribución de gas de la costa este de Estados Unidos, han conseguido bloquear el sistema público de empleo de España hace unos años también.

Cañada cree que ya estaremos por debajo de 10 porque los intentos cada vez son más elevados, señalando otro dato que le llama mucho la atención, de la Comisión Europea que establece que el costo del cibercrimen supone para la economía global 5.500 billones, es decir, “estamos hablando de una enorme cantidad de dinero que es el coste que tiene para la economía, para la sociedad, para los ciudadanos, todo lo que tiene que ver con los incidentes de ciberseguridad”. Agregando, “creo que aquí es importante hacer una reflexión más allá del dato, la OCDE habla de 6.000, perdón, de 6 trillones. Hay estudios que hablan, en Estados Unidos hay una publicación que habla de en torno a 10,5 trillones, billones de dólares, el coste actual que tiene esto.No voy a discutir las cifras, a mí esta cantidad ya me parece suficientemente significativa. Y es importante que tengamos en cuenta que esta cifra, lamento decirlo, va a seguir subiendo.

Cada vez que digitalizamos nuestra economía, cada vez que hacemos que vivimos, que trabajamos, que nos relacionamos en un mundo más digital, la superficie de riesgo, el espacio donde el ciberdelito puede actuar es mucho mayor. Por lo tanto, tenemos que asumir, tenemos que aceptar que estamos en una situación de gestión del riesgo y que el riesgo cero no existe y es probable que no exista”.

Falsa percepción de ciberseguridad

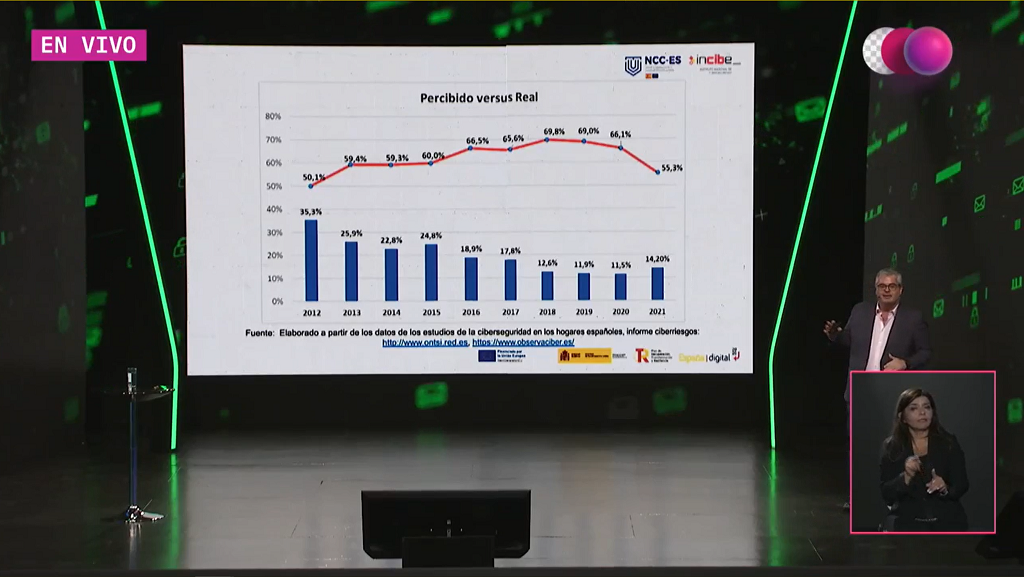

En un estudio realizado en España, donde se preguntó a los usuarios, empresas y ciudadanos cuál es su percepción sobre el uso fraudulento de sus equipos. Es decir, cuándo ellos han detectado a lo largo del año que han tenido algún intento exitoso de vulneración de sus sistemas. Desde el año 2012, la percepción de los ciudadanos es cada vez de vivir en un entorno más seguro, creen que sus ordenadores cada vez están mejor protegidos.

Miguel Ángel Cañada, indica que se están incorporando en su mindset, la necesidad de tener sistemas de protección de los equipos, de sus teléfonos, ser más cuidadosos a la hora de darle a un enlace en el teléfono móvil. ”Y esta percepción nos podría dar la falsa sensación de que eso que comentaba antes, de que cada vez el cibercrimen va incrementándose, pues no es una realidad”.

Agregando “nosotros que hacemos desde nuestro centro de respuesta a incidentes cibernéticos del monitoreo que hacemos de los equipos. Y como veis, la percepción que tenemos los ciudadanos y las empresas de lo que ocurre dista bastante de lo que realmente ocurre. Estamos hablando de en torno a un 50, 60, 60 y algo por ciento de equipos infectados, que es una cantidad bastante notable.

El grado de esa infección puede ser muy amplio, puede ser una infección muy leve, puede ser una infección que dé lugar o que pueda dar lugar a un riesgo más sistémico. Pero, en cualquier caso, estamos hablando de una falsa percepción de seguridad. A mí me gusta hablar de que estamos en este aspecto, estamos en un espacio zombi. Estamos en un espacio… Ese gap, esa diferencia entre la realidad y la percepción nos indica claramente que estamos en un espacio zombi, en un espacio donde no sabemos muy bien qué está ocurriendo pero que hay walking death que realmente están atacando nuestros equipos”.

Ciberseguridad e Inteligencia Artificial

“Tenemos que ser conscientes de que esta superficie de riesgo, este mundo donde estamos trabajando, cada vez va a tener mayor impacto”, señala el especialista, agregando, “es importante saber cómo podemos encarar esta realidad y qué papel va a jugar la inteligencia artificial y otras tecnologías habilitadoras. Primero, para saber cómo enfrentarlo y en segundo lugar, para saber cómo utilizarlo”.

Es evidente que estamos en un proceso de digitalización cada vez más profundo, la conectividad es mayor. Más del 90% de los hogares chilenos tienen acceso a Internet, ya sea móvil o sea mediante sistemas físicos, pero más del 90% está conectado a Internet. Por lo tanto, la conectividad cada vez va a ser mayor. Y esa conectividad está incorporando factores tremendamente disruptivos y la inteligencia artificial es uno de ellos.

“La inteligencia artificial y otras tecnologías habilitadoras van a incrementar esa conectividad, van a hacerla mucho más acelerada y, sobre todo, la van a hacer mucho más autónoma” indicó Cañada, enfatizando que “esa disrupción, ese Internet de las cosas, ese Internet de dispositivos conectados, a la medida que vayan incorporando más y más capacidades de inteligencia artificial, no sólo van a crear un mundo virtual cada vez más extenso, sino un mundo virtual con menor interacción del ser humano, un mundo mucho más autónomo”.

Destacando el ejemplo de como la Inteligencia Artificial es usada en autos autónomos. Y durante el proceso del sistema de circularización del dispositivo, pidieron a un grupo de hacker éticos que les ayudasen a testear cómo estaban haciéndolo, pues de los 10 o 12 intentos que intentaron, el 70% fueron exitosos. “Estamos hablando de un elemento que puede ir por la carretera a 100 km por hora con seres humanos dentro. Es un ejemplo. Y es un dispositivo que toma soluciones, que toma decisiones de manera autónoma. La inteligencia artificial va a incrementar notablemente esa toma de decisiones. Y, por lo tanto, la superficie de riesgo sin interacción humana se va a incrementar.

Y aquí, en esa enorme superficie de riesgo, nosotros lo abordamos y creemos que es la solución desde dos perspectivas.

La primera es gestionar el riesgo. Como os decía al principio, no vamos a controlar esta situación, tenemos que asumir que es imposible eliminar el riesgo en el ámbito cibernético, pero tenemos que saber gestionar el riesgo, minimizarlo, establecer y acotar cada vez más los lugares donde podemos ser vulnerables y evitar, en la mayoría de los casos, en la mayor medida posible, esos espacios de vulneración.

Pero también lo tenemos que ver como una oportunidad. La ciberseguridad es un sector económico que crece a más de dos dígitos anuales. Es una oportunidad de empleo, es una oportunidad de desarrollo económico, es una enorme oportunidad para reactivar la economía.

Por lo tanto, la ciberseguridad no solamente es un riesgo que hay que gestionar, sino que tiene también, además de ese alma de seguridad, tiene un alma muy importante desde el punto de vista del desarrollo económico.

Nosotros entendemos que esto hay que abordarlo desde tres perspectivas. La primera es el fortalecimiento de las capacidades, seguridad, que los ciudadanos y las empresas y los gobiernos estén cada vez más preparados para hacer frente a esta realidad. Y ahí trabajamos no solamente en red con todos los países para proteger de manera global esta realidad, porque este es un problema transnacional que no entiende de fronteras y por lo tanto hay que abordarlo también con esa transnacionalidad.

La inteligencia artificial es el tema de la neutralidad, la tecnología es neutra. Me van a permitir que exagere con un ejemplo un poco fuera de lugar, pero las armas no disparan, las armas se disparan. La IA tiene usos muy positivos y también tiene capacidad de hacer mucho daño. Por lo tanto, tenemos que trabajar, tenemos que entender que la inteligencia artificial es una tecnología y, por tanto, es un factor neutro y que, depende de la capacidad que desarrollemos en esta tecnología, estaremos en un escenario u otro».

En diciembre, el mes pasado, la Unión Europea aprobó la primera normativa de IA del mundo. Y solamente voy a destacar dos elementos clave en esa normativa. El primero, balancear el acceso a la innovación, el acceso a la tecnología, el acceso a los beneficios de la inteligencia artificial y los derechos y valores de la Unión Europea, que, por lo menos, sobre el papel presumimos, que son derechos humanos, que son derechos de las personas. Es decir, el valor del ciudadano y la inteligencia artificial, una inteligencia artificial al servicio. Y hay una segunda derivada de esa normativa y es la gestión del riesgo. A mayor capacidad de la inteligencia artificial, normas más estrictas.

La charla terminó volviendo a 1871, como marco conceptual para entender de qué se está hablando «cuando hablamos de ciberseguridad y de inteligencia artificial, tenemos que correr mucho, tenemos que avanzar mucho, tenemos que no pararnos para poder estar a la altura de las realidades y necesidades que nos exige la inteligencia artificial y del camino que recorren los ciberdelincuentes para aprovechar eso. Esto no lo planteo en términos épicos de una batalla entre el bien y el mal, pero lo que está claro es que tenemos que entender que si nos paramos, estamos muertos”.